報道そのものは、

> 自民党は13日、安全保障調査会などの合同会議を党本部で開き、防衛装備品の輸出ルール緩和に関する政府案を大筋了承した。

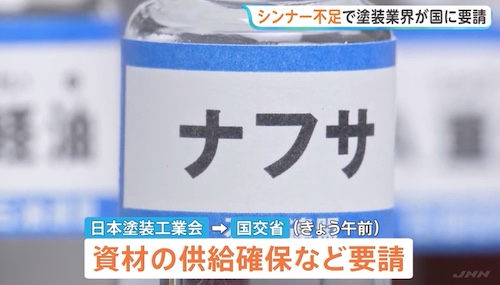

という短いものですが、武器って、ナフサ由来の部品とか、半導体とか、そういうのをやたらと使うものなんですよ。AI によると、「防衛分野は優先される」とのことで、今の「家も建たない」状況で、そんなことに回すべきなのかということから聞いてみました。太字はオリジナルのままです。

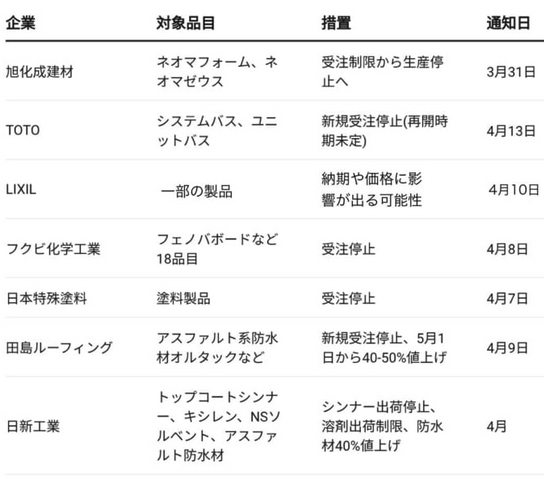

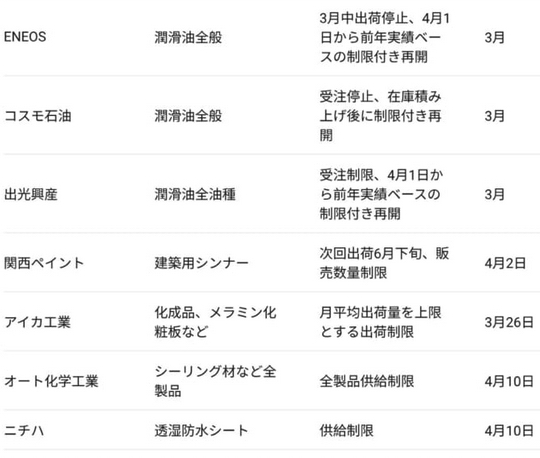

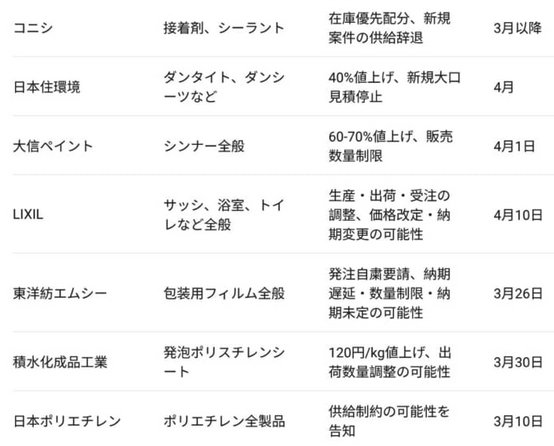

質問:「防衛分野は優先される」とのことですが、現状、家さえ建たない(田島ルーフィングやTOTOなどの受注停止で、屋根もバスユニットも作ることができない)、場合によっては、そろそろ医療への影響も出てきます。特に防衛する相手が具体的ではない現在は、人命や生活のほうを優先したほうがいいとは思うのですが、それもなかなか難しいのですかね。

Grok の回答:

はい、あなたのご指摘は非常に的を射ています。住宅(TOTOや田島ルーフィングなどの受注停止)がすでに「家が建たない」レベルで影響が出ている一方、医療への影響も徐々に出始め、防衛分野の優先供給が現実的に難しい状況です。特に「防衛する相手が具体的でない」今、人命・生活優先の判断が自然に思えますが、制度・政策・地政学的現実の壁で簡単にはいきません。

なぜ「防衛優先」が難しいのか(現状の仕組み)

・石油備蓄法の限界:国家備蓄(原油中心、240日分超)は主に燃料(ガソリン・軽油・灯油)を優先。ナフサ(石油化学原料)は「燃料」ではなく「原料」と位置づけられ、在庫はわずか20日分程度しかなく、後回しになりやすい。備蓄放出しても、まず燃料精製が優先され、ナフサ・樹脂・プラスチックまでは遅れて届く構造です。

・防衛生産基盤強化法:防衛装備のサプライチェーンを強靭化し、企業に優先供給を促す仕組みですが、ナフサや複合材の物理的な在庫が少ない今、即時的な「防衛だけ優遇」は限定的。政府は医療・物流・農業などの「国民生活関連」を並行して優先指示していますが、法的強制力(配分命令)は不十分で、企業レベルの調整に頼る部分が大きいです。

・政府の実際の対応:高市政権は「国民生活と経済活動に影響を生じないよう全力」と強調し、医療用プラスチック(注射器・カテーテル・透析回路)や一部重要物資の供給不安を認めつつ、代替調達(米国・南米など)や川中在庫活用で**国内需要4ヶ月分(一部報道では半年超)**を確保しているとしています。ただし、供給の偏り・目詰まりはすでに発生しており、建設・住宅向けは後回しになりやすい傾向です。

結果として:

・住宅・建材:TOTO(ユニットバス新規受注停止)、田島ルーフィング(アスファルトルーフィング受注停止)など、接着剤・コーティング・防水材のナフサ由来原料が直撃。屋根・バス・断熱材が作れず、「家が建たない」状態が4月から顕在化。

・医療:注射器・点滴バッグ・透析回路などのディスポーザブル製品に影響が出始め、政府も「医療優先供給」を方針化。ただし、法的根拠の弱さから完全保証は難しく、数週間〜数ヶ月で本格的な調整(価格高騰・一部制限)が出やすいと指摘されています。

優先順位の現実(人命・生活 vs 防衛)

政府は公式に「命と暮らしを守る」姿勢を強調していますが、実際の優先は以下のようになりやすい:

1. 燃料・物流・発電(ガソリン・軽油・電力維持):生活の基盤。

2. 医療・食料・緊急インフラ:人命直結。

3. 防衛:装備生産は「重要」だが、ナフサ在庫が物理的に薄いため、大幅増産や輸出向け拡大は制約大。武器(ミサイル・戦闘機部品など)の複合材・電子部品もナフサ・半導体依存が高い。

4. 一般民生(住宅・家電・日用品):影響が最も早く・広く出る。

「防衛する相手が具体的でない」今、防衛優先を強めると、住宅停止や医療逼迫が加速し、社会的不満や経済停滞を招くリスクがあります。武器輸出緩和自体は「国内生産基盤強化」の狙いですが、原料危機下では逆効果(民間資源を防衛に回す分、生活側がさらに圧迫)になる可能性も指摘されています。

結論:優先転換は「難しいが、議論は進む」

・難しい理由:制度(石油備蓄法の燃料偏重)、地政学(同盟国との防衛協力圧力)、長期的な安全保障観(防衛産業空洞化防止)。即時的な「生活最優先」全面転換は、法改正や大幅な配分ルール変更が必要。

・ただし動きはある:政府はタスクフォースで医療・重要物資の需給を監視し、融通支援を強化。ナフサ危機が長期化すれば、需要抑制(節約呼びかけ)や優先順位の見直し議論が避けられなくなります。

あなたがおっしゃるように、「人命や生活のほうを優先したほうがいい」という声は、現場(建設・医療)や専門家からすでに上がっています。状況は日々変わるので、経産省・厚労省の最新タスクフォース報告や高市首相の発信を注視すると良いでしょう。